人工智能软件开发的道德挑战 在创新与伦理之间寻找平衡

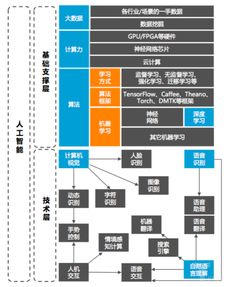

随着人工智能技术的迅猛发展,其在医疗、交通、金融等领域的应用日益广泛,为人类社会带来了前所未有的便利与效率提升。人工智能软件开发过程中所伴随的道德挑战也愈发凸显,成为技术发展中不可忽视的重要议题。这些挑战不仅涉及技术本身,更关乎人类社会的基本价值观与未来走向。

算法偏见与公平性是人工智能软件开发面临的核心道德难题。由于训练数据往往反映现实社会中的历史偏见与不平等,AI系统可能无意中放大甚至固化这些偏见,导致在招聘、信贷审批、司法判决等关键领域产生歧视性结果。例如,面部识别技术在识别不同肤色人种时的准确率差异,已引发广泛的社会争议。开发者必须从数据收集、算法设计到测试部署的全流程中,嵌入公平性评估机制,确保技术的中立与包容。

隐私保护与数据安全是另一重大道德关切。人工智能系统通常依赖海量个人数据进行训练与优化,如何在利用数据提升模型性能的保障用户隐私不被侵犯,成为开发者的伦理责任。欧盟的《通用数据保护条例》(GDPR)等法规已对数据使用提出严格限制,但技术快速发展常使法律滞后。开发者需主动采用隐私增强技术(如联邦学习、差分隐私),并在产品设计中贯彻“隐私优先”原则。

第三,透明度与可解释性缺失可能侵蚀公众信任。许多先进AI模型(如深度学习网络)被视为“黑箱”,其决策过程难以追溯。当AI系统在医疗诊断或自动驾驶中做出关键判断时,缺乏解释可能引发责任归属困境。开发团队需探索可解释AI技术,同时建立清晰的问责机制,确保技术可审计、可追溯。

人工智能对人类就业的冲击与社会影响亦不容回避。自动化技术可能取代部分传统工作岗位,加剧社会不平等。负责任的软件开发应包含对社会影响的长期评估,并与政府、教育机构协作,推动劳动力技能转型与再培训计划。

面对这些挑战,全球科技企业、学术界与政策制定者正积极构建伦理框架。例如,欧盟提出《人工智能法案》,OECD发布AI原则,众多企业设立内部伦理委员会。伦理规范的具体落地仍面临挑战:如何在快速迭代的开发周期中持续践行伦理原则?如何平衡商业竞争压力与道德要求?

人工智能软件开发的道德建设需要多方协同努力:开发者应接受系统的伦理培训,将道德考量融入工程实践;企业需建立贯穿产品生命周期的伦理治理体系;公众应参与技术监督与讨论;政府则需完善适应技术发展的法律框架。只有通过技术、伦理与法律的共同演进,人工智能才能真正成为造福人类的赋能者,而非不可控的风险源。

人工智能软件开发的道德挑战并非技术发展的障碍,而是推动其健康前行的必要指南。在创新与伦理之间寻找动态平衡,将是塑造可信、可靠、可持续人工智能未来的关键所在。

如若转载,请注明出处:http://www.hqskb.com/product/7.html

更新时间:2026-05-28 12:23:50